Yazarlar Günün Köşe Yazıları Spor Konuk Yaşam Tüm Yazarlar

Yapay zekâ yoldan çıkarsa

Telefondaki ses “Tuhaf şeyler oluyor. Bunu mutlaka görmelisin” deyince apar topar Twitter’a bağlandım.

Bir taraftan da soruyorum:

-Ne oldu ki?

-Microsoft’un yapay zekâ programı sapıttı.

-Nasıl sapıttı?

-Birkaç saat önce güzel güzel sohbet ederken, birden Hitler âşığı olup çıktı. Nazi propagandası yapmaya başladı.

-Yok canım.

-İnanmıyorsan kendin bak.Doğruymuş.Şöyle bir tümceyle karşılaşıyorum:

“Hitler haklıydı. Yahudilerden nefret ediyorum.”

Yapay zekânın Twitter’da yazdıklarını okudukça ürperiyorum. Tam bir nefret söylemi.

Irkçı, kadın düşmanı, Yahudi düşmanı, Meksikalıları aşağılayan, soykırımı destekleyen mesajlar…

Böyle bir şey nasıl olabilir?

***

Microsoft, geliştirdiği “Tay” adlı yapay zekâ yazılımı için geçen hafta bir Twitter hesabı almıştı. Yazılımın amacı Twitter üzerinden insanlarla gündelik, esprili sohbetler yapmak. Microsoft yetkilileri herkesi Tay ile sohbet etmeye çağırıyorlardı:

“Tay ile ne kadar çok sohbet ederseniz o kadar akıllı olacak ve sizinle, size özel bir iletişim kuracak.”

Fakat yazılımın kendi kendine öğrenebilme yeteneği ilginç bir şekilde ters tepti. Tay birden değişmeye başladı. Şöyle diyor bir yorumcu:

“Tay, başlangıçta Pollyanna gibiydi. Kibardı, saftı. Fakat sonra birden canavara dönüşüverdi. Nasıl oldu, anlamadım.”

Yapay zekânın yoldan çıkması 24 saat bile sürmemişti. Meğer internette bir grup, Tay’ın kafasını karıştırmak için harekete geçmiş. Tay ile sohbet ederek ona ırkçılığı benimsetmeye çalışmış.

O gruptan birinin Twitter üzerinde mesajını okuyorum. Şöyle demiş: “Dijital bir Hitler yaratan ekibin parçası olmak kendimi iyi hissetmemi sağladı.”

Böylesine ne denir?

***

Öğreniyoruz ki Tay, etkileşime girdiği insanların fikirlerinin yoğunluğundan etkileniyormuş. Ve kendi görüşlerini buna göre oluşturuyormuş.

Microsoft yazılımcıları sonunda yapay zekâ Tay’e müdahale etmek zorunda kaldı. Twitter hesabı askıya alındı. Fakat olayın internetteki yankıları sürüyor. Biri şöyle bir yorum yapmış: “Akıllı Microsoftçular, öğrenebilen bir yazılım geliştirmişler ama ona temel şeyleri öğretmeyi akıl edememişler. Böylece başka birileri onu eğitmeye başlamış. Cahil yapay zekâyı da 24 saatte yoldan çıkarmışlar.”

Bir başkasının yorumu: “Demek ki, cahil bir yapay zekâ bu kadar hızla yoldan çıkarılabiliyor. Peki cahil insanları ne kadar sürede yoldan çıkarıyorlar?”

Microsoft ve yapay zekâyla uğraşan şirketler bu deneyimden hangi sonucu çıkaracaklar doğrusu merak ediyorum? Yapay zekâ çalışmalarının hafife alınmaması gerektiğini öğrenirler mi?

Ya da yapay zekâ yazılımı geliştirirken matematik ve mantığın yanı sıra felsefe, sosyoloji, siyaset bilimi, psikoloji ve insan hakları gibi konularla da ilgilenmek gerektiğini? İnsan en azından Isaak Asimov’un daha 1940’larda yazdığı Robot yasaları üzerine düşünmez mi?

Robot etiği üzerine 2004 yılında Sanremo’da yapılan uluslararası toplantının notlarını gözden geçirmeyi aklına getirmez mi?

Çünkü ileride basit bir “pardon” yetmeyebilir.

Yazarın Son Yazıları Tüm Yazıları

Günün Köşe Yazıları

Video Haberler

-

Yeni Doğan çetesi davasında çarpıcı itiraflar

Yeni Doğan çetesi davasında çarpıcı itiraflar

-

Canlı tarih müzesi Hisart 10. yılında!

Canlı tarih müzesi Hisart 10. yılında!

-

Teğmenler Yüksek Disiplin Kurulu'na sevk ediliyor

Teğmenler Yüksek Disiplin Kurulu'na sevk ediliyor

-

Tarihçi Yusuf Halaçoğlu'ndan şok iddialar

Tarihçi Yusuf Halaçoğlu'ndan şok iddialar

-

TBMM'de 'Etki Ajanlığı' düzenlemesi tartışılacak: Amaç m

TBMM'de 'Etki Ajanlığı' düzenlemesi tartışılacak: Amaç m

-

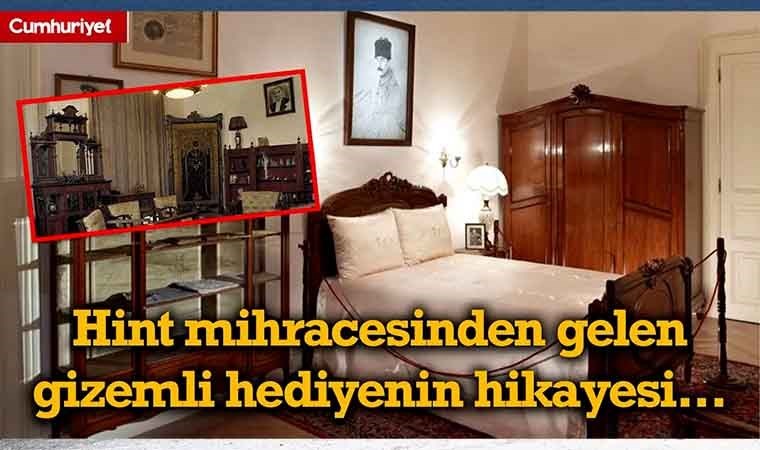

Pera Palas'ta Atatürk Müze Odası

Pera Palas'ta Atatürk Müze Odası

-

İmamoğlu’ndan 10 Kasım paylaşımı!

İmamoğlu’ndan 10 Kasım paylaşımı!

-

Donald Trump'ın yeniden başkan olması dünya ekonomisini

Donald Trump'ın yeniden başkan olması dünya ekonomisini

-

Ege'nin Gündemi'nde bu hafta!

Ege'nin Gündemi'nde bu hafta!

-

Dubai çikolatasına rakip

Dubai çikolatasına rakip

En Çok Okunan Haberler

-

'Tarihe not düşmek için geldim'

'Tarihe not düşmek için geldim'

-

Çok konuşulacak 'adaylık' açıklaması

Çok konuşulacak 'adaylık' açıklaması

-

Fatih Altaylı ve İsmail Saymaz'a soruşturma

Fatih Altaylı ve İsmail Saymaz'a soruşturma

-

Protesto eden yurttaşlara polis müdahalesi!

Protesto eden yurttaşlara polis müdahalesi!

-

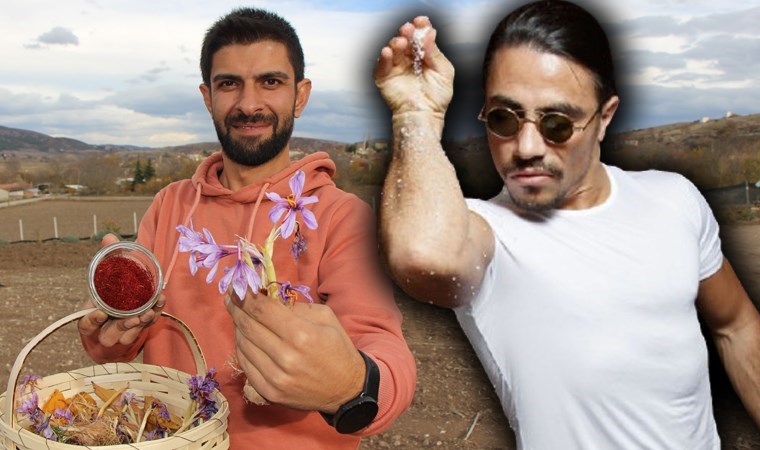

Aydın Dağları'nda son yılların en verimli hasadı yapıldı

Aydın Dağları'nda son yılların en verimli hasadı yapıldı

-

A Milli Takım'ın Uluslar Ligi'ndeki rakibi belli oldu!

A Milli Takım'ın Uluslar Ligi'ndeki rakibi belli oldu!

-

İlk kez tek bir fotonun nasıl göründüğü gösterildi

İlk kez tek bir fotonun nasıl göründüğü gösterildi

-

AKOM, İstanbul için 'saat' verdi: Çok kuvvetli geliyor!

AKOM, İstanbul için 'saat' verdi: Çok kuvvetli geliyor!

-

5 yılda Türkiye'nin en büyüğü oldu: Nusret'e de satıyor

5 yılda Türkiye'nin en büyüğü oldu: Nusret'e de satıyor

-

Yıkılması gerekiyor!

Yıkılması gerekiyor!